近日,由 AI 巨頭 Anthropic 推出的終端開發工具 Claude Code 在全球開發者社群引發廣泛爭議。多名資深工程師與企業用戶指出,該工具在近期更新後出現明顯性能退化,不僅推理能力下降,甚至導致開發成本大幅上升。相關討論迅速在 GitHub、Reddit 與 Hacker News 等平台擴散,最終迫使 Anthropic 官方出面回應,並提供應對建議。

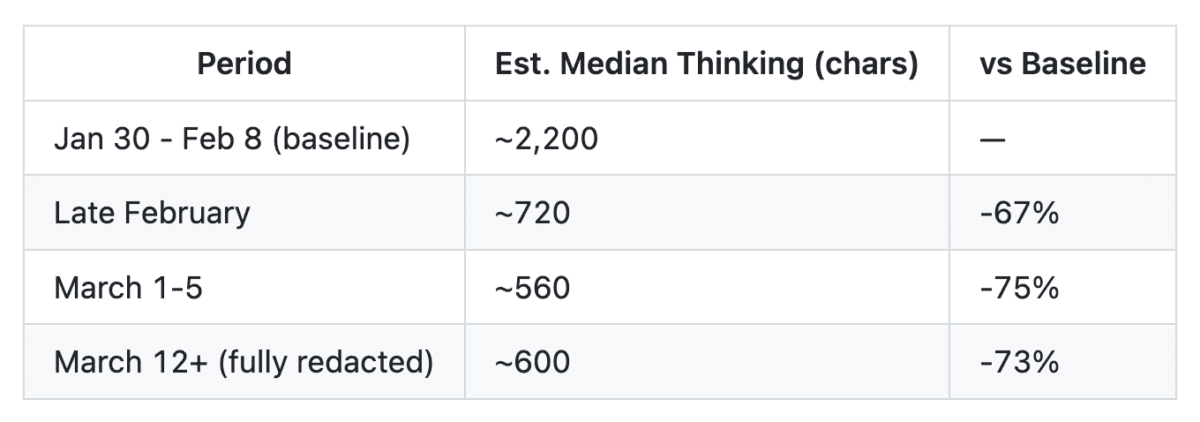

這場風波最早源自 GitHub 上一則編號為 #42796 的討論串。AMD AI 部門資深工程師 Stella Laurenzo 發布了一份詳細分析,指出其團隊在使用 Claude Code 進行大規模程式重構時,遭遇顯著的「性能懸崖」。根據其提供的日誌數據,自 2026 年 2 月中旬以來,模型在部分任務中的推理深度明顯縮減,幅度高達 67%。

由於模型無法進行充分推理,錯誤程式碼輸出頻率上升,導致系統反覆進入「報錯—修正—再報錯」的循環,使 API 呼叫量暴增至原先的數十倍,進一步推高整體開發成本。

更令開發者不滿的是,模型在更新後不再顯示完整的推理過程,而是直接輸出結果,使工程師難以判斷其決策邏輯,降低了工具在專業開發場景中的可控性與信任度。

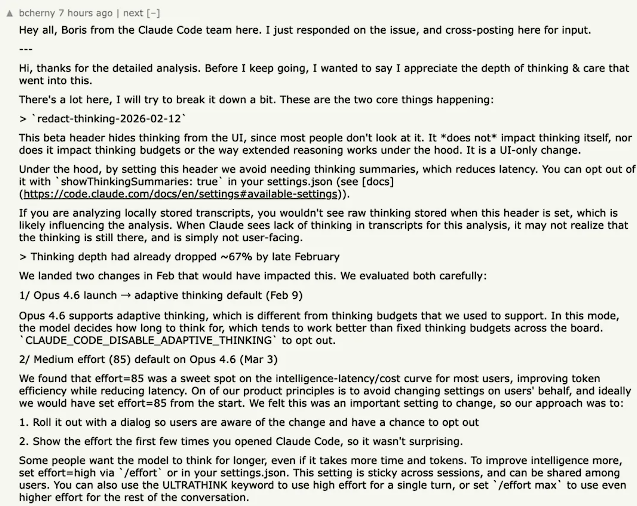

隨著質疑聲浪升高,Anthropic 技術負責人 Boris 隨後出面說明,強調問題並非來自模型本身能力下降,而是多項以「效率優先」為導向的系統調整所致。他表示,公司自 2 月起引入「自適應思考」機制,讓模型根據任務難度自動調整推理資源;同時在 3 月調降預設推理強度,以降低延遲與成本。此外,為了簡化使用介面,也預設隱藏了推理過程的細節(使用者可透過settings.json中的showThinkingSummaries: true選項恢復顯示)。

然而,這些調整在實際應用中引發反效果。開發者普遍認為,系統對任務難度的判斷並不準確,導致在複雜工程場景中過度壓縮推理資源,進而影響結果品質。更有批評指出,Anthropic 在未充分告知的情況下調整預設設定,實際上等同於以成本優化為優先,犧牲了專業工具所需的穩定性與可靠性。

面對壓力,Anthropic 亦提供了數項調整建議,協助用戶恢復較高品質的推理能力。工程師可透過手動設定提高模型推理強度,或關閉自適應思考機制,避免系統自動降低運算資源;同時也能重新啟用推理過程的顯示功能,以提升對模型行為的可觀察性與控制力。

這起事件也引發業界對生成式 AI 發展路徑的反思。隨著 AI 工具逐步走向大規模商用,如何在算力成本與模型性能之間取得平衡,成為所有廠商必須面對的核心問題。對一般使用者而言,降低延遲或許能提升體驗,但對高度依賴 AI 進行自動化開發的工程師來說,推理深度的細微變化都可能對整體工作流程造成連鎖影響。